使用易翻译批量处理多个文件,通常有三条路:在软件里批量导入/拖拽并设置目标语言与输出选项;用命令行或API把文件夹提交到翻译队列并设置并发与重试;对大文件先分片翻译再合并,同时用术语表、翻译记忆与质量阈值保证一致性。

先把核心思想讲清楚(像给朋友解释)

想象你在做饭,要同时给十个人上菜。你不会一份一份地单独做完再开始下一份;你会分批准备材料、安排几个人同时做、并把相同的调味料统一放在一处。同理,批量翻译文件就是把“文件当作原材料”,把“翻译流程当作厨房”,用工具把重复工作自动化、并行化、标准化。

三个基本要点(Feynman式简化)

- 批量输入: 把所有文件一次性送进系统,而不是逐个打开翻译。

- 并行与分片: 对小文件同时处理,对大文件拆成片段处理后再合并。

- 质量保障: 用术语表、翻译记忆和质量阈值来保持译文一致性。

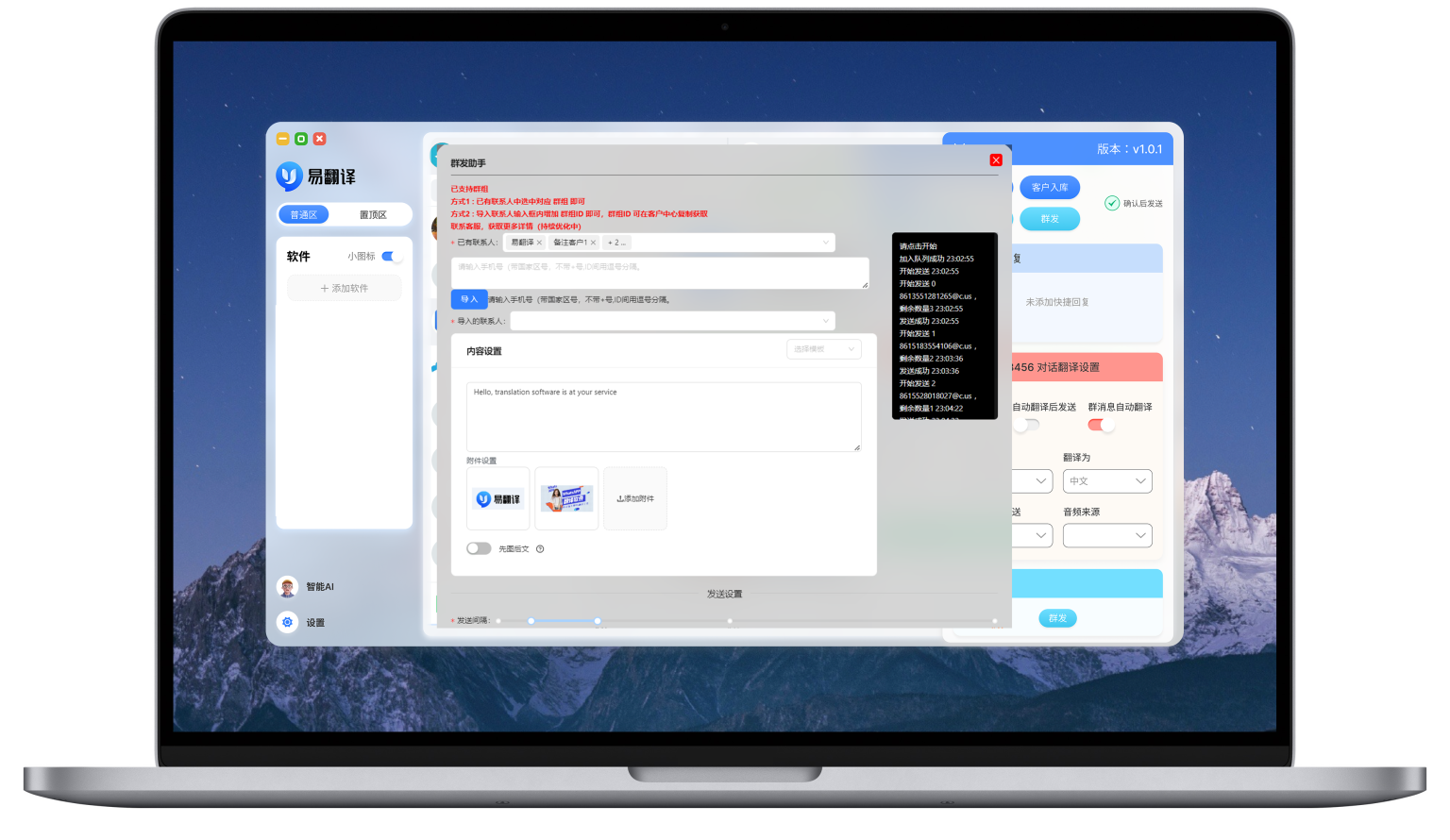

方法一:软件界面操作(适合不熟命令行的人)

这是大多数人会选的方式,因为直观、少出错。步骤其实很简单,像在文件管理器里拖东西。

步骤分解

- 准备: 把需要翻译的文件放在一个文件夹,按类型做子文件夹(例如:文档、表格、字幕)。

- 导入/拖拽: 在易翻译的“项目”或“批量翻译”界面,选择“批量添加”或直接将整个文件夹拖进去。

- 选择设置: 目标语言、翻译引擎、是否使用翻译记忆(TM)、术语库(Glossary)、输出格式(原格式保留或导出为TXT/JSON)等。

- 命名与输出路径: 设定命名规则(例如:filename_LANG_timestamp),选择输出位置,避免覆盖原件或混乱。

- 并发与速率: 在设置里调整并行任务数量(threads/processes)和速率限制,平衡速度与稳定性。

- 开始并监控: 点击“开始/翻译”,监控进度,查看错误日志并适时重试失败项。

界面设置技巧(显得更专业)

- 模板化设置: 把常用语言对和输出配置保存为模板,下次一键加载。

- 分文件类型规则: 对.docx保留格式,对.xlsx指定翻译列,对.srt保留时间码。

- 预检查: 先做小批量试译,确认术语和格式没问题再跑全量。

方法二:命令行与API(适合自动化与集成)

如果你有很多文件并且希望把翻译嵌入到工作流,比如CI/CD、云端脚本,命令行或API是更稳妥的选择。它省力、可重复,也方便日志管理。

典型流程(伪命令示例)

下面是一种常见的工作流程示意(具体命令以易翻译提供的CLI/API为准):

- 1) 打包或标记要翻译的文件夹:zip my_docs/ 或者把文件列表写到 files.txt。

- 2) 调用上传接口:POST /translate/batch 上传文件夹或文件清单,同时指定语言对、引擎、并发数。

- 3) 查询任务状态:GET /translate/status/{task_id},直到任务完成。

- 4) 下载结果:GET /translate/result/{task_id},将译文放回指定目录并根据命名规则重命名。

举个更具体但通用的伪示例:

upload –folder ./to_translate –lang en-CN –engine standard –concurrency 4 –glossary gloss.csv

poll_status –task-id 12345

download –task-id 12345 –out ./translated

自动化关键点

- 幂等性: 脚本应能重复运行而不产生重复或冲突的输出(例如先检查目标文件是否存在)。

- 错误重试与回退: 对于网络或API错误做指数退避和有限重试,并把失败项记录到日志表。

- 并发控制: 根据服务器限制和翻译配额设置合理的并发数,避免被节流或封禁。

方法三:处理大型文件(拆片、上下文保持与合并)

大文件(比如上万字的报告或长视频字幕)直接一次性提交会遇到超时、内存或格式丢失问题。解决思路是“智能拆片、并行翻译、再合并”,同时保证上下文尽量保留。

拆片策略

- 按段落或章节拆: 保持语义完整,避免在一句话中间断开。

- 使用重叠窗口: 每片保留前后几句作为上下文(例如重叠2-3句),减少断句导致的翻译不连贯。

- 索引与合并: 为每片生成索引(如chapter_01_part_01),翻译后按索引顺序合并,并去重重叠文本。

合并时要注意

- 恢复原始格式(例如.docx样式、段落编号、表格结构)。

- 时序文件(如.srt)需要严格保持时间码不变,只替换文本。

- 合并后做一致性检查,尤其是术语与专有名词是否一致。

质量控制:术语、翻译记忆和后编辑

批量翻译最怕“同一词在不同文件里被翻成不同的东西”。这是可以预防的。

- 建立术语表: 把客户或项目特有词汇固定下来,导入到工具并优先匹配。

- 使用翻译记忆(TM): 让机器记住已翻译过的句子,下次遇到相同或相似句子时自动套用或建议。

- 设置质量阈值: 对自动翻译结果设置信心水平或相似度阈值,低于阈值的句子自动标记为需要人工校对。

- 后编辑(PE): 把机器先译的结果交给人工做快速校对,优先处理高优先级文件。

文件类型与格式处理要点

不同文件类型需要不同处理方式,下面是一张小表帮你一眼看清:

| 文件类型 | 处理建议 | 注意点 |

| DOCX | 导入并保留样式,或导出文本段落翻译后再回写 | 表格与脚注可能需要特别处理 |

| XLSX/CSV | 指定要翻译的列,保留表头与格式 | 注意单元格公式与占位符 |

| SRT/ASS | 逐条翻译并保留时间码 | 时间码对齐、行数限制要检查 |

| 优先提取可编辑文本或先转DOCX再处理 | 扫描件需OCR,排版可能丢失 |

常见问题与排错思路

- 文件太多导致卡死: 分批导入,降低并发,或临时提高内存配额。

- 翻译结果格式错乱: 检查是否用了纯文本导入而丢失了样式;改用保留格式的导入/导出。

- 术语不一致: 确认术语表是否已正确导入并启用;在测试批次中验证生效。

- 任务中途失败: 查看错误日志,定位是网络、配额还是文件编码问题;针对性重试失败项。

实践小技巧:提高效率与可追溯性

- 统一命名规范: 推荐格式:项目_语言_日期_版本,例如:projA_en-zh_20260301_v1。

- 保留原文快照: 把原始文件做一次只读快照,便于回滚与审计。

- 分批大小调优: 试验不同批次大小,找到既快又稳定的最佳点(通常10–50个小文件一批)。

- 日志与报告: 自动生成翻译统计(字符数、成本、错误率),便于结算和质量回溯。

落地示例工作流(给你照着做)

假设你要把100个产品说明从英文翻成中文:

- 1) 把100个说明放进 products_en/ 文件夹,按每50个文件分两个子文件夹。

- 2) 在易翻译中创建项目,导入两个子文件夹,加载术语表和TM。

- 3) 设置并发为4,开启错误重试3次,输出命名规则为 filename_zh-cn。

- 4) 先翻译第一批50个,检查术语和格式,确认无误后批量翻译第二批。

- 5) 合并结果,运行一致性脚本(检查关键字段是否被翻译或错翻)。

简单时间估算(经验值)

小文件(<200KB)批量并行处理,单批50个在网络良好和并发4的情况下,常见在几分钟到半小时内完成。大文件或复杂格式会更久,需要拆片与人工校对。

好了,这些是把“多个文件一起处理”落地的全套思路和操作细节。你可以按上面的三种方法(界面、API、拆片合并)结合自己的工作习惯来选用,并在早期多做小批测试以减少后续返工。如果你愿意,我可以再把这套流程按你的实际文件类型和工作环境(Windows/Android/macOS)细化成逐步操作清单。好了,先这样,边写边想,可能还有些小地方我会再补上。