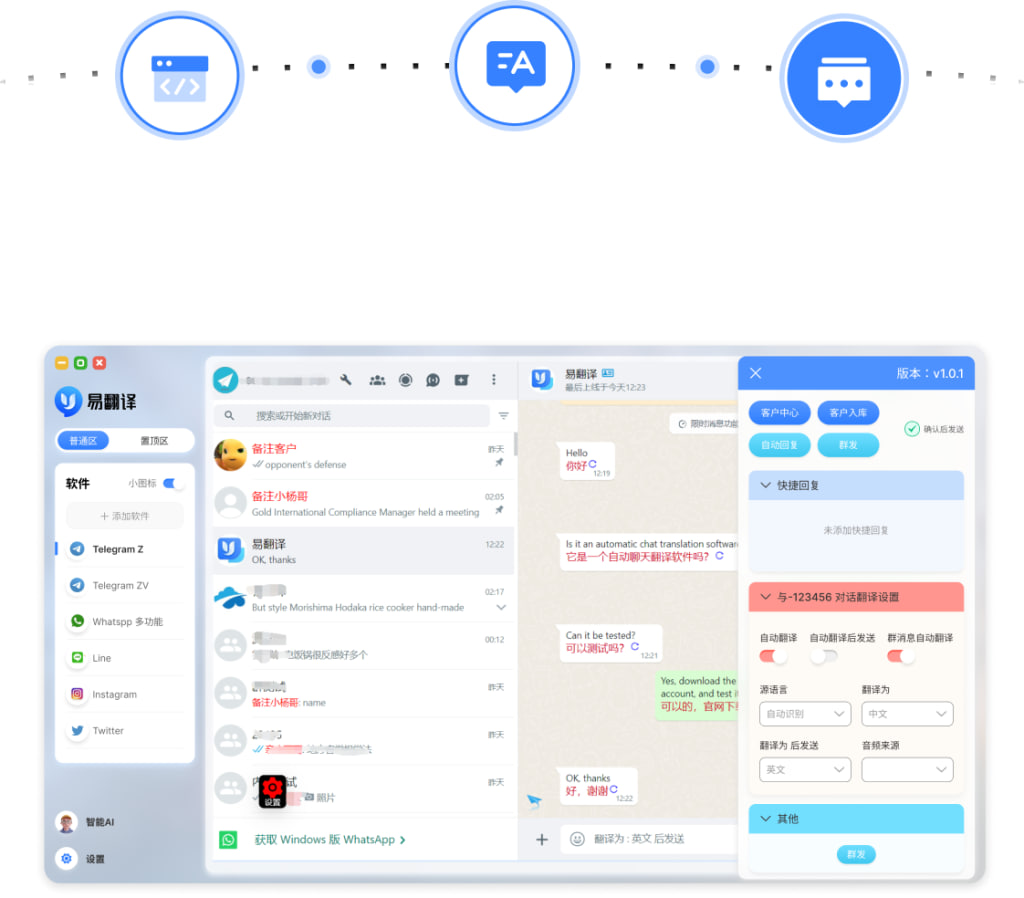

易翻译接下来可能推出更强的离线神经网络、实时多模态(语音、图片、视频)互译、文档级上下文理解、个性化词库与风格控制、低延迟同声传译、隐私本地化与企业级管理功能,逐步融合大模型解释、学习辅助和无障碍手语支持。并改善口音识别、低资源语言覆盖、多人会议与翻译记忆同步。并提供更灵活的隐私和企业管理选项可选。

为什么这些功能会被优先开发?

简单来说,产品要解决的是“人能说话但机器听不懂、机器翻得不够用”这两个瓶颈。用户场景越来越多样:旅行时需要离线快速识别牌匾,会议中要保证多方实时互动,学习时又想要能纠正发音并解释语法。技术上,移动端算力、模型压缩、以及多模态模型的成熟,让很多曾经只能在云上做的事,可以搬到手机本地或低延迟边缘运算上。

可能出现的新功能(按场景说明)

出行与日常交流

- 离线高质量翻译包:体积更小但保留关键能力,适合无网络环境。

- AR实时翻译:用相机识别菜单、路牌并直接覆盖目标语言,交互更顺手。

- 口音自适应识别:识别并转换不同口音,减少“识别失败”的尴尬。

会议与商务

- 低延迟同声传译:几百毫秒延迟即可理解对方意图,配合同步字幕或语音。

- 多方说话者区分(speaker diarization):会议记录时能标注谁说了什么。

- 企业词库与翻译记忆(TM):行业术语同步,保证译文一致性。

学习与教育

- 双向纠错与解释模式:翻译之外,给出简单的语法解释与例句。

- 发音评分与训练:结合即时反馈,做短练习并保存进度。

- 个性化学习路线:根据用户错误频率生成复习卡片(间隔重复)。

无障碍与多语种覆盖

- 手语识别与生成:相机识别手语并转换成文字/语音,或生成手语动画。

- 低资源语言支持:通过迁移学习和社区众包提升濒危或少数语言覆盖。

核心技术路线(用最简单的话解释)

把复杂的事分成几层来做:第一层是“听”和“看”(ASR、OCR、图像检测);第二层是“理解”(NMT、多模态融合、上下文管理);第三层是“说”(TTS、语气保留)。每一层都能独立改进,但效果最好的是把它们串起来做端到端优化。

主要技术点

- 轻量化神经网络:把大模型压缩到手机能跑的体积(知识蒸馏、剪枝、量化)。

- 端到端语音翻译:少中间环节,声音直接进出,延迟更低、连贯性更强。

- 多模态对齐:把图像、文字、语音的“意思”放到同一个向量空间,便于互译和注解。

- 个性化微调:用户词库、公司术语可以在本地或私有云微调模型,得到风格一致的译文。

- 隐私保护技术:本地推理、差分隐私、联邦学习用于降低数据外泄风险。

功能推出的时间表(一个可能的路线)

| 阶段 | 可见功能 | 用户收益 | 技术难度 |

| 短期(6–12个月) | 离线包、改进ASR、企业词库导入、低延迟字幕 | 更稳定、隐私更好、专业术语一致 | 中等 |

| 中期(1–2年) | 端到端语音翻译、AR翻译升级、发音评分 | 更流畅、更直观的交互体验 | 较高 |

| 长期(2–5年) | 手语支持、多模态生成、同声传译级别体验 | 覆盖更多群体,接近人工口译质量 | 高 |

需要面对的挑战与权衡

- 延迟 vs 精度:想把延迟降到几十毫秒,往往要牺牲一些模型复杂度;反之亦然。

- 本地处理 vs 云能力:把功能放本地利于隐私与离线,但对低端设备有限制。

- 低资源语言的数据稀缺:需要社区、合成数据或迁移学习来填补,这过程中容易引入偏差。

- 可解释性与误翻风险:尤其是在商务或法律文本中,错误代价高,应增加置信度提示与人工复核通道。

给用户的一些实用建议

- 旅行前下载离线语言包并测试常用短句(如问路、订餐)。

- 启用并维护个人/团队词库,遇到专有名词先添加再翻译,长期收益明显。

- 在重要商务场合,开启“人工校对”或保存原语音供人工复核,别完全依赖自动翻译。

- 关注隐私设置:是否上传语音、是否保留日志、是否同步到云,这些选项要根据用途调整。

给企业和开发者的建议

- 从API与翻译记忆(TM)入手,先解决术语一致性问题。

- 考虑按场景训练小模型(行业模型),再做轻量级部署。

- 利用用户反馈与人工标注不断微调模型,建立质量评估体系(QE/QE指标)。

说到这里,可能你会问“那什么时候能用上?”嗯,短期改进其实能很快看到,比如更好离线包和企业词库;中长期像手语支持、同声传译那类,需要行业合作和更长时间打磨。总的思路是一步步把“能听懂、能理解、能表达”三个能力线上化、模块化,让普通用户在旅行、学习、工作中一点点感到省心。可能我讲得不够严谨的地方还会有,想到哪儿写到哪儿,欢迎你指出你最关心的场景,我可以再针对性展开。