易翻译对四川话的处理不是绝对二元的:在文本输入下,常见的川渝方言词汇和短句往往能被识别并输出标准普通话或英文;但在语音实时互译时,若说话者口音强、用词土语化,识别与翻译的准确率会下降;拍照取词主要取决于书写形式;双语对话模式下的流畅度则受模型和网络影响但通过设置与纠正能明显改善体验建议尝试多种方式

先说明结论,后把原理讲清楚(像费曼那样)

把“易翻译能否翻译四川话”看成一门小实验。关键要分清两件事:一是你是“写出来的四川话”还是“说出来的四川话”;二是你想要什么结果,是把它变成标准普通话,还是翻成英文、法文之类。不同输入和不同目标,会得到不同的效果。下面我把原理、表现、举例、调优方法一步步拆开,尽量让你像跟朋友聊天一样明白怎么用、怎么测试、怎么提升。

为什么会有差别?——原理和技术要点

语音识别(ASR)与机器翻译(MT)是两件不同的事

语音识别把声音变成文字,靠的是声学模型和语言模型。如果训练数据里四川话样本少,或者口音差异大,识别结果就会错;机器翻译把一种文本转换成另一种文本,依赖于平行语料与上下文。两者是串联关系:前者错了,后者也接着错。

方言的三个挑战

- 发音差异:四川话的声母、韵母和声调与普通话不同,导致ASR容易把词识别成普通话里的相近词。

- 词汇特有性:很多土语词(比如“安逸”“巴适”)在标准语料里频率低,翻译模型未必学过它们的语义对照。

- 书面与口语差异:口语化的省略、连读、语气词,会让识别和翻译都更加困难。

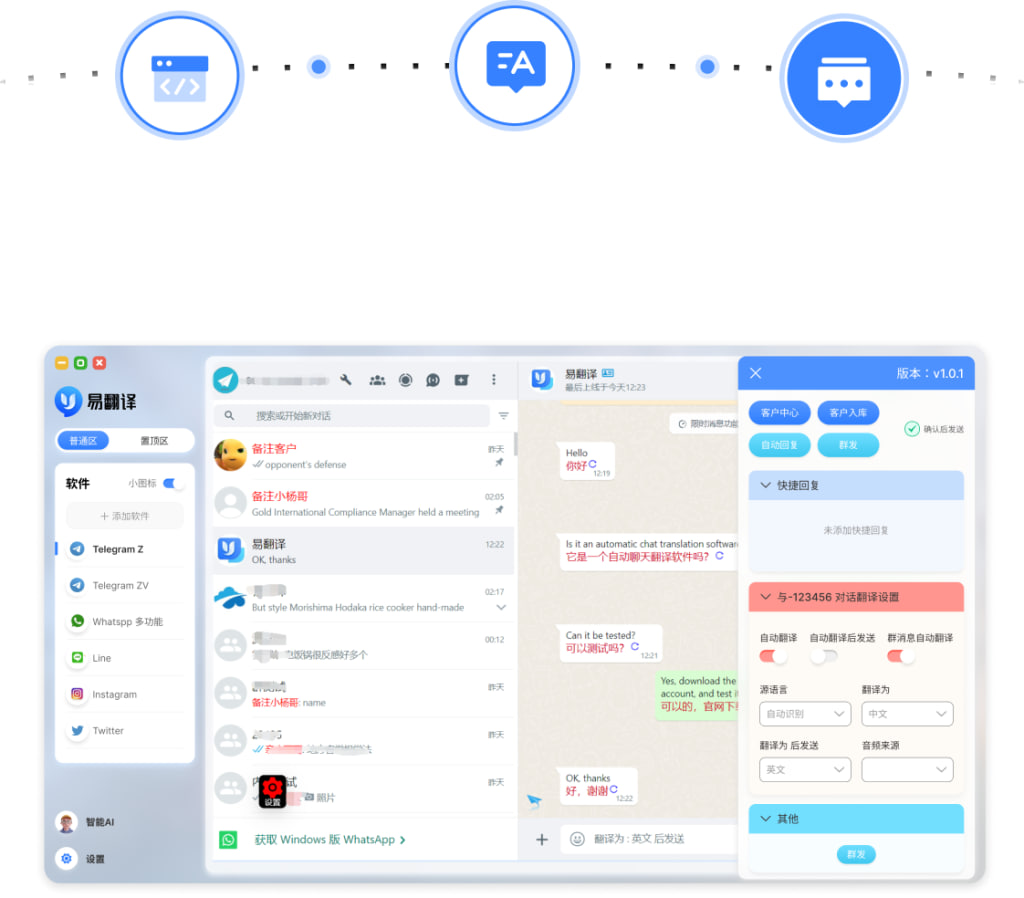

易翻译四大功能对四川话的表现(一张表看清楚)

| 功能 | 对应技术 | 对四川话的典型表现 | 可改善性 |

| 文本输入翻译 | 机器翻译(NMT) | 若输入为川话书面词汇,通常能输出接近的普通话或英文,但极土语可能无直接对应 | 高(通过自定义词典、上下文提示) |

| 语音实时互译 | ASR + MT | 口音强时识别错误较多,翻译质量下降;普通话夹杂川话则效果更好 | 中(音质、语速、模型支持与纠错能显著提升) |

| 拍照取词翻译 | OCR + MT | 如果是书写文字(如手写、招牌、菜单),识别取决于字体与书写规范,方言词汇只要有文字则可翻译 | 高(清晰图片与手动校正帮助大) |

| 双语对话翻译 | 实时ASR + 对话管理 | 对话中的短句、常见方言词在双向翻译中能被处理,但流畅度与延迟受网络、模型优化影响 | 中(设置与重复提示能改善) |

一些具体例子:四川话短语与可能结果

举几个常见例子,说明易翻译会怎么处理,以及你该怎么说才能让机器更懂你。

| 四川话 | 可能被识别/翻译成 | 说明 |

| 安逸(ānyì) | 舒服 / very comfortable | 这是川渝常用词,很多翻译系统已学习,文本翻译通常准确。 |

| 巴适(bāshì) | 舒服、合适 / comfortable, just right | 口语常见,文本输入好翻译,语音输入取决于发音清晰度。 |

| 耙耳朵(pá ěr duo) | 软弱的丈夫 / henpecked husband | 文化负载词,若目标语言文化中无直译,机器会给释义或近义表达。 |

| 打哈儿子(dǎ hā er zi) | 打瞌睡 / dozing off | 连读和语气词会影响ASR,建议放慢、清晰发音或改为书面表达。 |

实操技巧:如何让易翻译更好地“明白”四川话

- 尽量用文字输入关键方言词:如果你知道某词的书写形式,直接输入文字最可靠。

- 说得慢一点、吐字清楚:ASR对快语和连读敏感,放慢能显著提升识别率。

- 混合表达法:先用四川话说一遍,再用普通话复述关键词,方便系统二次校验。

- 利用纠错功能:当识别结果错误时,手动修正并“保存短语/生词”,让应用学习你的偏好(若支持)。

- 使用上下文:在文本里多给上下文句子,机器翻译更能推断方言词的含义。

如何自己做个小测试来评估效果

想知道你所在城市/方言的识别率?做个简单实验:

- 列出20句常用四川话口语,覆盖日常、问候、情绪表达、地方菜名等。

- 分别用三种输入方式测试:文本输入、语音输入(清晰说)、语音输入(正常说话速度)。

- 记录每句的识别文本与最终翻译,把错误类型分为:ASR错误、MT误译、文化无对等三类。

- 统计正确率,并尝试上文提到的调优方法(慢说、混合表达),看改进幅度。

常见误区(和别被坑)

- 误区一:方言没被“支持”并不意味着完全不能用。很多时候是“降低准确率”,而非“完全不能识别”。

- 误区二:语音识别不准不一定是模型问题,环境噪声、话筒质量、网络延迟都可能是罪魁。

- 误区三:翻译结果若看起来“奇怪”,先检查识别的中间文本是什么,再判断是ASR还是MT出错。

开发者角度:能做哪些技术改进?

如果你对背后技术好奇,这里简短说几条改进思路(也方便你理解为什么提示有用):

- 收集本地语料:把四川话书面文本、语音样本加入训练集是根本;

- 多域适配:餐饮、旅游等场景的术语需要单独建模;

- 在线学习与用户反馈循环:用户手动纠错后,模型能少量更新,提高个性化识别;

- 改进噪声鲁棒度:在嘈杂环境下增强声学模型的鲁棒性。

如果你真的需要高质量翻译(建议的流程)

对重要场合(商务、法律、医疗)我有明确推荐:先用文本确认关键术语,然后再做人工校对。机器能帮你把大意转出来,但细节与文化偏差最好交给懂方言和目标语言的人把关。

一些术语小解释(方便理解上面那些词)

- ASR:Automatic Speech Recognition,即语音识别。

- MT / NMT:Machine Translation / Neural Machine Translation,即(神经)机器翻译。

- OCR:Optical Character Recognition,即图像文字识别。

- 方言词表:模型中专门记录的方言词与对应标准语义的映射表。

说点更生活化的:我在成都街头试过几款翻译App,发“安逸”“巴适”它们懂,叫我“走嘛”就常被识别成“走吗”。这其实挺正常——因为模型见过多少“走嘛”就决定了它会不会识别。所以,用易翻译时,多给点上下文、必要时换成拼音或普通话,体验会好很多。啊,这篇边写边想还有点乱,反正你要是想我可以把上面那 20 句测试模板直接列出来,或者帮你写一套“常用四川话到普通话/英文”的短语表,随时说话。