经查公开资料与常见技术痕迹,不能单凭界面断言。总体上,易翻译通常会在产品层和某些模块(界面、前处理、商业优化)进行自主研发,但在核心的语音识别、机器翻译基础模型与大规模训练资源上,常见做法是结合或调用第三方算法、云服务或开源模型。要确认具体自研比重,可看专利、论文、代码仓库、招聘职位与隐私许可等信息。

先把“自主研发”这个概念弄清楚

说一个产品“有自主研发”听起来很明确,但其实里面有很多层次,像洋葱一样一层层剥开。我先把基本思路说清楚——这样后面看证据就不会糊里糊涂了。

什么是“自主研发”?

自主研发可以理解为公司自己从零或在已有基础上改造、训练并掌控关键技术与代码的能力。简单分三类:

- 完全自研:核心算法、模型训练、数据采集到部署基本由公司自己完成;

- 混合式:公司在产品和部分模块中自研(优化、微调、工程实现),但在底层算法、预训练模型或云服务上借用第三方或开源成果;

- 服务型依赖:产品主要拼接第三方 API 或云服务,自己的贡献主要是 UI、业务流程和集成。

所以“有无自研”不是二选一问题,而是“哪一层自研以及自研的程度”。

为什么判断不是那么简单?

原因有三:一是很多公司会把开源模型微调后当成自研成果来讲;二是厂商间会在文案上弱化第三方依赖(“基于多种技术”之类的);三是关键证据(训练数据、模型参数、内部文档)通常不公开。因此需要看多类公开证据并交叉验证。

翻译类产品技术拆解:哪些部分可能自研?

把产品拆成若干模块就容易判断了。像搭一栋房子,墙面、门窗、地基、暖气、装饰都可以分别由不同人做。

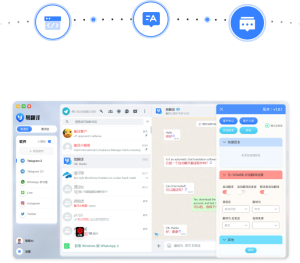

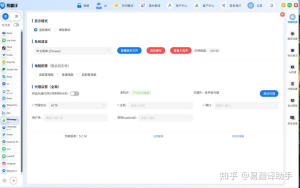

- 前端与产品逻辑:界面、对话管理、缓存策略、本地离线包、SDK。企业通常会自研以满足用户体验和商业需求。

- 语音识别(ASR):把音频变成文字。技术路线有传统 HMM-GMM、端到端 CTC/Attention/Transducer、以及基于预训练模型(如 wav2vec)的方案。

- 机器翻译(MT):从源语言到目标语言。常见是基于 Transformer 的神经机器翻译,或者在大模型基础上微调。

- 语音合成(TTS):把文字变成自然语音,技术有 Tacotron/FastSpeech + WaveNet/HiFi-GAN 等。

- 图像 OCR 与取词:文本检测 + 识别(如 CRNN);复杂场景会有布局分析、语言检测等。

- 后处理与业务化优化:术语保持、分段策略、低延迟缓存、个性化词典、隐私脱敏等,这些往往决定产品体验,很可能是自研的。

- 基础设施:模型压缩、量化、边缘部署、调度系统、安全与合规层面(用户数据隔离),这类也常需要工程层面的自研。

常见的研发组合模式(现实里最常见)

下面是几种常见组合,个人感觉很多中小型或初创产品是第二种或第三种:

- 重度自研型:从数据到模型到部署都自己做,常见于有深厚科研背景或大量数据资源的公司。

- 混合型:使用开源或第三方预训练模型,再做微调、工程化和产品化。

- 集成/依赖型:主要靠云服务(如主流云厂商或语音厂商 API)拼接出完整功能,投入在产品与市场。

如何客观判断一家翻译产品(比如“易翻译”)有没有自主研发?

不要只看宣传语,按步骤来看。下面是一套实操性强的检查表,我把它写得像检查家里水管那样,跟着一步一步查就行了。

一、官方及公开技术材料

- 查公司官网、产品白皮书、技术博客:是否公开论文、技术报告或架构图?有无“论文-代码-数据”链条?

- 查 App 内关于页或“关于我们”:是否写明“powered by 某云/某引擎”?若有明确第三方声明,说明依赖性较强。

- 阅读隐私政策与许可声明:是否说明用户语音/文本会被送往第三方?是否提到模型来源或第三方 SDK?

二、科研与专利线索

- 检索公司名下的专利(国家知识产权局)、公开论文(中文/英文检索)、技术大会发言。

- 如果公司有多篇关于特定算法、数据采集或模型优化的论文,说明研发深度较高。

三、代码与仓库

- 查 GitHub/Gitee 等仓库:公司是否公开了模型训练代码、工具链或 SDK 源码?

- 没有公开代码并不等于没有自研,但公开代码是强证据。

四、招聘与团队

- 看公司招聘页、领英/拉勾/智联的职位描述,关注是否招大量研究/算法/数据工程岗位(NLP、语音、机器翻译)。

- 招很多工程产品职位但没有算法岗,往往说明更依赖第三方技术。

五、产品行为与技术指纹

- 离线包大小:若提供离线翻译,离线包很大通常意味着有自研或整合了本地模型;若仅在线且低延迟靠云调用。

- 响应延迟:调用云端大型模型通常有更高延迟;极低延迟并且支持复杂对话可能有本地或边缘优化。

- 翻译风格/错误模式:通过对比样本(把同一句子分别放到若干翻译服务中)可看是否像某知名引擎的输出。

- 日志或 SDK 报头:移动端抓包(仅在合法和得到许可的前提下)可观察请求去向,是否调用第三方域名。

证据解读表(快速参考)

| 证据类型 | 提示含义 |

| 公开论文/会议发表 | 强指向:公司在算法、模型或新方法上确有产出 |

| 专利 | 中强指向:说明在某些实现或应用上投入专门研发 |

| 公开代码仓库 | 强证据:可直接看实现细节与算法 |

| 隐私政策/许可页写明第三方 | 说明依赖或使用第三方云/算法 |

| 招聘大量算法岗 | 间接证据:公司有扩展自研能力的意图与资源 |

| App 标注 “Powered by X” | 直接说明使用外部技术 |

技术层面你能做的一些“味道测试”

这些方法不需要内部资料,但可以给你直观感受:

- 对照测试:把一组句子(包含俚语、术语、长句、短句)分别输入易翻译和几个公开服务(如主流云厂商的翻译)比对输出风格与错误类型。

- 延迟与鲁棒性:在弱网、成批短句、长句、噪声语音下测试服务表现,观察是否有降级策略或本地回退。

- 离线功能测试:是否能完全离线工作?离线包有多大?通常本地化模型意味着有一定程度自研或工程化打包。

- 术语一致性:专业词汇或自定义词典的支持程度,若能上传并持续记忆,说明有较成熟的后处理或定制化能力。

法律与数据层面:用户数据是否被用来训练模型?

很多人关心隐私,这与是否“自研”也有关联:自研公司可能更容易提供“本地训练/私有化方案”,但不一定。重点看隐私条款:

- 是否明确用户数据会被用于模型训练?若明确说明“用于改进模型”,说明公司在数据闭环上有计划(可能自研或与第三方共享);

- 是否提供企业版或本地化部署(on-premise)选项?通常这需要较强工程能力;

- 是否支持数据隔离、加密、删除请求等合规操作?这类功能需要工程自研成本。

举个应用这个方法的例子(模板式的分析思路)

假设你在做尽职调查——你会这样做:

- 去公司官网+App关于页,查“技术白皮书/联系我们/隐私/关于”——有没有“powered by”或第三方协议?

- 搜专利与论文:有没有近三年关于“机器翻译/语音识别/端到端模型”的发表?

- 看招聘:过去一年公司是否在招大量算法/数据岗位?岗位描述是否写“训练模型/数据清洗/分布式训练”?

- 实际测试产品:做翻译风格对比、离线测试、语音嘈杂环境测试、术语保持测试;记录相似度与差异。

- 如果可以,观察网络请求域名或 SDK 报头,判断请求是否发向第三方云。

判断后的可能结论与对应建议

- 大部分自研:若有论文、专利、代码和大量算法岗,说明公司确实有研发能力。对企业用户来说,这通常意味着更可定制、更可控,但也要评估数据安全与运维能力。

- 混合模式:若只有少量论文或较多的产品工程岗,说明公司在工程化与产品化方面投入大,实际算法可能基于开源/第三方但做了深度定制。用户可以根据需求选择是否接受。

- 依赖第三方:若公司公开声明使用第三方云,或者请求都发向第三方域名,说明主要是集成型产品。优点是快速、稳定;缺点是灵活性与个性化受限,且数据掌控需看隐私策略。

最后说两句比较生活化的话

我写到这里,像是在拆一台手机看看哪个零件是厂商自己做的。很多时候厂商不会把所有零件都自己做,因为成本太高,速度太慢,市场也不等人。判断“有无自研”更像是拼图:几块科研论文、几条招聘、几个隐私条款、一次离线测试,就能把图拼出大致轮廓。你要是想更确定,就把我上面那张清单一条条对照着查,能拿到三五项强证据基本就可以下结论了。